در دنیای پرتلاطم فناوری، هوش مصنوعی نهتنها به عنوان یک ابزار پیشرفته بلکه به عنوان یک نیروی دگرگونکننده در زندگی بشر ظاهر شده است.

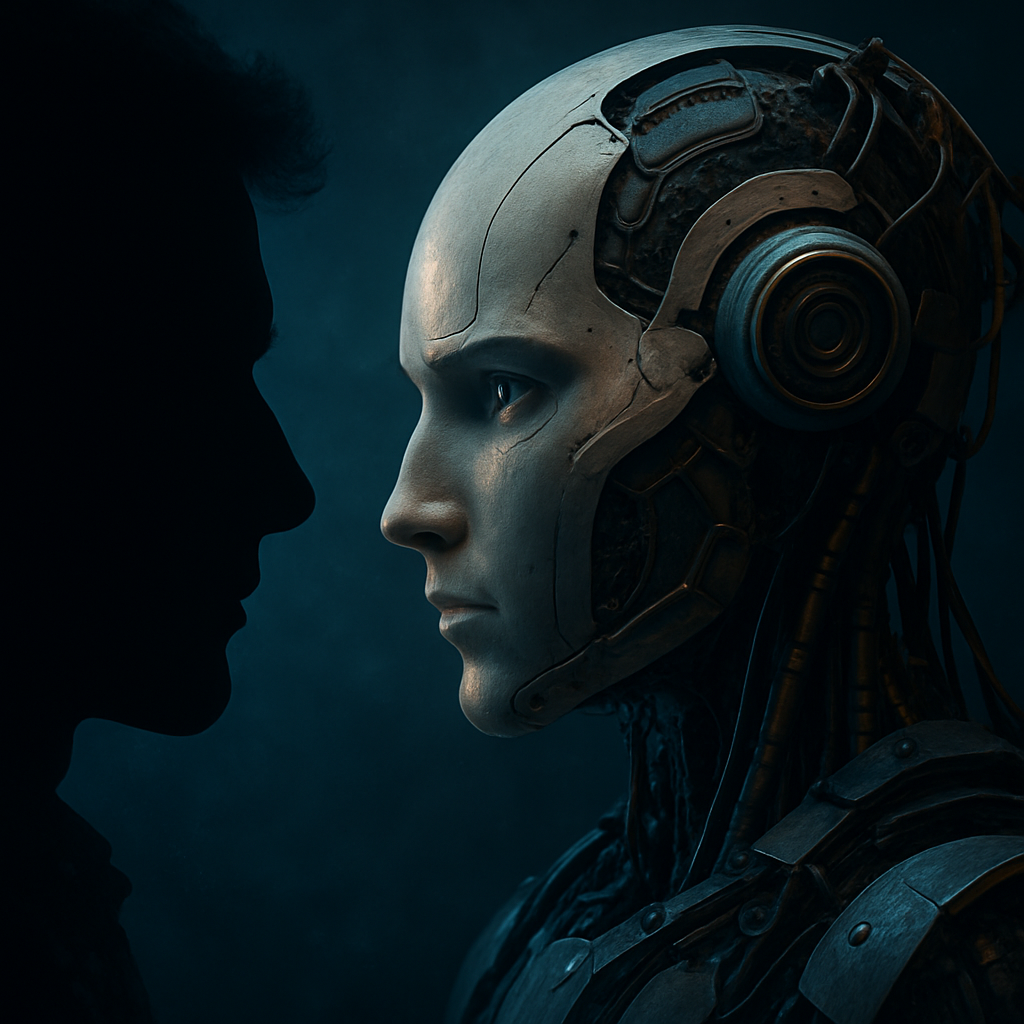

اما آیا AI صرفاً در خدمت انسان است یا در حال بازتعریف قدرت، کنترل و حتی مفهوم انسان بودن است؟

در این مقاله با رویکردی تحلیلی، دوگانه «تهدید» و «فرصت» بودن هوش مصنوعی را بررسی میکنم و شما را از حقایقی آگاه که احتمالاً از آنها بیخبر بودهاید.

۱. هوش مصنوعی: شریک مطمئن یا جاسوس خاموش؟

همه ما از مزایای کاربردی AI مطلعیم: تشخیص بیماریها با دقت بالا، تحلیل دادههای عظیم، افزایش بهرهوری کسبوکارها و حتی کمک به کشف داروهای جدید.

اما پشت این لایه درخشان، دغدغههایی عمیق نهفته است.

سیستمهای AI به دادههای شخصی ما وابستهاند و بسیاری از آنها از طریق گوشی، وبسایتها یا ابزارهای پوشیدنی به اطلاعات حساسی دسترسی دارند.

سؤال اساسی این است که این دادهها کجا ذخیره میشوند؟ چه کسی به آنها دسترسی دارد؟ و در نهایت، برای چه هدفی استفاده میشوند؟

پاسخ این سؤالات همیشه روشن نیست.

شرکتهای فناوری، بهویژه غولهای حوزه دیجیتال مانند Google، Amazon، Facebook و ByteDance، به دلیل گردآوری بیوقفه اطلاعات کاربران تحت نظارت و انتقاد گسترده قرار گرفتهاند.

شاید AI در ظاهر به ما خدمت کند، اما در عمل، میتواند با تحلیل الگوهای رفتاری، تصمیمات سیاسی و اقتصادی ما را تحت تأثیر قرار دهد.

در این معنا، هوش مصنوعی نه یک ابزار بیطرف، بلکه یک واسطه پرقدرت در شکلدهی به آینده فردی و جمعی ماست.

در سالهای اخیر، فاش شدن استفاده از دادههای کاربران برای مهندسی اجتماعی، هدفگیری تبلیغات انتخاباتی، و حتی تحریک به خشونت نشان داده که این «جاسوس خاموش» تا چه اندازه میتواند اثرگذار باشد.

در همین راستا، مفهوم «سواد داده» (data literacy) و آموزش کاربران برای کنترل و مدیریت دادههای خود اهمیتی حیاتی پیدا کرده است.

نقش دولتها در قانونگذاری، شفافسازی فرآیندهای جمعآوری داده، و اعمال مجازات برای سوءاستفادههای احتمالی نیز حیاتی است.

۲. قدرت بیقید یا متحد قابلاعتماد؟

هوش مصنوعی میتواند بدون خستگی تصمیم بگیرد، مسائل را تحلیل کند و پاسخهایی ارائه دهد که انسانها حتی متوجه پیچیدگی آن نمیشوند.

در صنایع نظامی، AI اکنون در پهپادهای خودران، سامانههای شناسایی هدف و حتی تصمیمگیری در حملهها نقش دارد.

در تبلیغات دیجیتال، الگوریتمها میدانند شما چه میخواهید حتی پیش از آنکه خود بدانید.

یکی از ترسناکترین سناریوها، افزایش اتکای تصمیمگیران به توصیههای «غیرقابل درک اما قابل اتکا»ی الگوریتمهاست.

تصمیماتی که توسط مدلهای یادگیری عمیق گرفته میشوند ممکن است از نظر آماری درست باشند اما درکی از زمینه، اخلاق یا پیامد انسانی آن ندارند.

مشکل اینجاست که AI هیچ درکی از «اخلاق» ندارد.

یک الگوریتم نمیداند چه چیزی «درست» یا «غلط» است، مگر اینکه این مفاهیم در قالب داده به آن داده شود.

آیا ما به اندازه کافی معیارهای اخلاقی را در کدهای خود پیاده کردهایم؟

آیا اگر AI تصمیم نادرستی بگیرد، میتوانیم آن را متوقف کنیم؟ یا اصلاً متوجه این خطا خواهیم شد؟

در مقابل، شرکتهایی که با اصول اخلاقی، شفافیت و کنترل دقیق سر و کار دارند، توانستهاند از AI به عنوان یک متحد استراتژیک استفاده کنند.

سازمانهایی مانند DeepMind و OpenAI تلاش دارند با انتشار سیاستهای اخلاقی و نظارتپذیر کردن مدلهای خود، مسیر توسعه مسئولانهتری را پیش بگیرند.

همچنین ائتلافهایی بینالمللی در حال شکلگیریاند تا راهکارهای قانونی برای کنترل توسعه AI وضع کنند.

اتحادیه اروپا در حال تصویب مقررات جامع برای استفاده اخلاقی از هوش مصنوعی است.

یونسکو و سازمان ملل نیز با همکاری دانشگاهها، اصول جهانی برای استفاده عادلانه از AI را تدوین کردهاند.

پس اگرچه AI میتواند بدون قید و کنترل به یک قدرت ناشناس تبدیل شود، با مدیریت صحیح میتوان آن را به متحدی مطمئن و حتی تسهیلکننده تصمیمات اخلاقمدار تبدیل کرد.

۳. آیندهای که خودمان مینویسیم، یا ماشینی که جای ما تصمیم میگیرد؟

یکی از جذابترین جنبههای بحث AI، اثرات آن بر تصمیمسازی و آیندهسازی بشر است.

با هوشمندتر شدن الگوریتمها، مرز بین توصیه و تصمیم کمرنگتر میشود.

مثلاً در حوزه مالی، نرمافزارهای AI اکنون میتوانند پیشنهاد سرمایهگذاری بدهند که در ۹۰٪ موارد از مشاوران انسانی دقیقترند.

در آموزش، سیستمهای یادگیری تطبیقی میدانند که چه چیزی را کی و چگونه به شما آموزش دهند.

در پزشکی، الگوریتمهایی وجود دارند که با دقتی خارقالعاده قادر به تشخیص بیماریهایی چون سرطان پوست یا آریتمی قلبیاند.

در دادگاهها، برخی کشورها از الگوریتمهای «پیشبینی جرم» برای کمک به قاضیها استفاده میکنند.

اما این اتکا به AI چه تبعاتی دارد؟

آیا ما توانایی تحلیل، شهود و تجربه را از دست خواهیم داد؟

آیا تصمیمات انسانی به تدریج به ورودیهای ماشینی تقلیل خواهند یافت؟

یا برعکس، هوش مصنوعی میتواند ظرفیتهای انسانی را تقویت کرده و به ما کمک کند تصمیمات بهتر، آگاهانهتر و سریعتری بگیریم؟

واقعیت این است که پاسخ این پرسش به ما بستگی دارد.

AI صرفاً ابزاری است.

این انسانها هستند که تصمیم میگیرند از آن در جهت قدرت، کنترل و سوءاستفاده استفاده کنند یا در مسیر همزیستی، همکاری و تعالی انسانی.

در این میان، آنچه تعیینکننده است، «فرهنگ برخورد با فناوری» است.

ما باید یاد بگیریم که چگونه با فناوری تعامل کنیم، از آن بیاموزیم، آن را مهار کنیم و به کار گیریم.

اینجاست که آموزش، اخلاق، فلسفه، سیاست و هنر همگی نقش پیدا میکنند.

آیندهای که در آن AI متحد ماست، فقط در صورتی ممکن میشود که ما در جایگاه «راهبری آگاهانه» قرار بگیریم؛ نه در نقش مصرفکنندهای بیاختیار.

آخرین نظرها: